Una nuova analisi sui modelli Llm pubblicata da Gartner segna un passaggio decisivo nella maturità della GenAI. Entro il 2030, secondo l’istituto, l’inferenza di un modello da un trilione di parametri costerà oltre il novanta per cento in meno rispetto al 2025. Il dato sembra segnare una svolta, eppure nasconde un cambio di paradigma più profondo. L’ecosistema non si muove soltanto verso l’efficienza, ma verso un nuovo equilibrio tra risorse computazionali, architetture flessibili e una domanda di potenza di calcolo destinata ad aumentare più del previsto. Il punto non è il costo unitario dei token, quanto la quantità di elaborazione richiesta dai sistemi più sofisticati.

Nel documento, Gartner stabilisce che un token equivale a 3,5 byte, circa quattro caratteri. L’unità di misura appare minima, ma diventa il cuore della dinamica economica. I modelli di frontiera consumano volumi di token molto più elevati delle applicazioni mainstream. Le piattaforme agentiche, per esempio, richiedono tra cinque e trenta volte più token per attività rispetto a un chatbot tradizionale. Di conseguenza, l’efficienza in crescita si scontra con una domanda computazionale in accelerazione.

Indice degli argomenti

L’accelerazione tecnologica spinge l’efficienza

Secondo Gartner, il calo dei costi di inferenza deriva dall’evoluzione dei semiconduttori, dalla maturazione delle infrastrutture e dalla diffusione di silicio specializzato. Le nuove generazioni di chip aumentano il throughput e riducono i consumi, mentre i sistemi di orchestrazione ottimizzano il carico. Gartner spiega che “questi miglioramenti dei costi saranno guidati da una combinazione di miglioramenti dell’efficienza dei semiconduttori e dell’infrastruttura, innovazioni nel design dei modelli, maggiore utilizzo dei chip, uso crescente di silicio specializzato per l’inferenza e impiego di dispositivi edge per casi d’uso specifici”.

L’effetto moltiplicatore di queste innovazioni porterà a un salto di efficienza fino a cento volte rispetto ai modelli del 2022. Il confronto non riguarda solo la miniaturizzazione, ma soprattutto la capacità dei sistemi di sfruttare pienamente la potenza disponibile. I data center diventano più intelligenti, mentre l’edge computing riduce la latenza e limita l’invio di volumi eccessivi di dati verso i nodi centrali.

Due scenari: frontier e blend

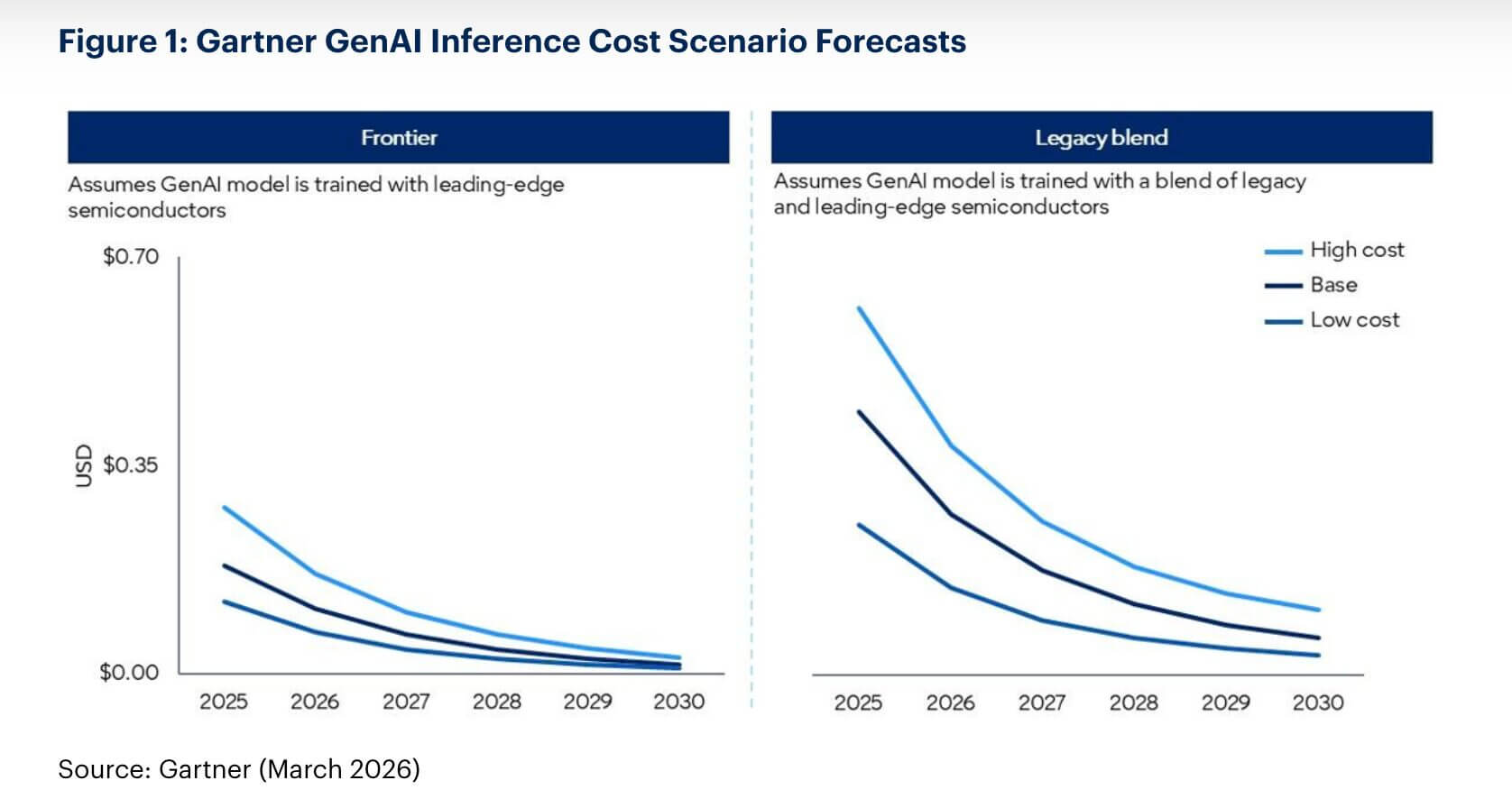

L’istituto distingue due traiettorie. Gli scenari frontier si basano sulla prossima generazione di semiconduttori e rappresentano la fascia più avanzata del mercato. I costi risultano più contenuti perché la potenza per chip aumenta più velocemente dei consumi. Nelle proiezioni blend, invece, l’evoluzione appare più graduale. I modelli Llm si appoggiano su un mix eterogeneo di semiconduttori e l’efficienza progredisce a velocità inferiori.

La differenza crea una frattura crescente tra chi può accedere alla capacità di calcolo più avanzata e chi resta vincolato a soluzioni meno performanti. Le imprese dovranno valutare quale infrastruttura adottare, perché la sostenibilità dei servizi di GenAI dipende da una pianificazione coerente. Gartner chiarisce che la riduzione del costo del token non riguarda in modo uniforme tutto il mercato, ma solo il segmento che investe nei componenti di ultima generazione.

La democratizzazione non dipende dal token

L’abbattimento dei costi non significa una reale democratizzazione della GenAI avanzata. Gartner sottolinea che il costo unitario non riflette la complessità dell’elaborazione richiesta dai modelli più sofisticati. La quantità di token elaborati crescerà più rapidamente della riduzione dei costi. Per i Cpo, il rischio è considerare i token come commodity e ignorare l’impatto dell’architettura. Sommer avverte che “i Cpo non devono confondere la deflazione dei token commodity con la democratizzazione del reasoning di frontiera”.

La spinta verso applicazioni agentiche e reasoning complesso comporta un consumo superiore di risorse. Le piattaforme devono gestire sequenze lunghe, cicli di verifica e azioni successive, aumentando così il carico computazionale. Per questo motivo, anche riducendo il costo unitario, l’inferenza complessiva tende a crescere. Il vantaggio economico non deriva solo dal prezzo, ma dalla capacità di distribuire l’elaborazione nel modo più efficiente possibile.

Il ruolo strategico dell’orchestrazione

La convergenza tra silicio specializzato, edge e modelli Llm impone nuove logiche di orchestrazione. La sostenibilità richiede che le attività ricorrenti vengano affidate a modelli verticali o di piccola taglia, più efficienti e spesso più accurati quando allineati a domini specifici. Solo i compiti ad alta marginalità dovrebbero transitare sui modelli di frontiera. È un cambio di mentalità rispetto agli ultimi anni, dominati dall’idea che modelli sempre più grandi offrano sempre più valore.

Gartner avverte che “i Cpo che oggi mascherano inefficienze architetturali con token a basso costo troveranno difficile raggiungere la scala agentica domani”. Le piattaforme devono integrare sistemi modulari, capaci di scegliere il modello più adatto a ogni compito e di limitare l’impiego dei sistemi più pesanti. L’orchestrazione diventa il nodo competitivo del mercato. Chi saprà sviluppare architetture bilanciate potrà estendere le capacità della GenAI mantenendo sotto controllo i costi.

Verso un ecosistema maturo della Genai

Il quadro delineato dall’analisi Gartner mostra un ecosistema in trasformazione profonda. L’industria si muove verso una fase più strutturata, in cui la crescita non dipende solo dalla potenza dei modelli Llm, ma dalla capacità di integrarli in architetture intelligenti. Le imprese devono anticipare l’aumento del consumo di token e le esigenze dei sistemi agentici, investendo in piattaforme scalabili e in un’infrastruttura orientata al futuro.

La maturità del mercato passa dalla gestione della complessità. La riduzione del costo dei token, pur significativa, non è la soluzione al problema della sostenibilità. Il vero fattore abilitante consiste nella combinazione di silicio evoluto, edge computing, orchestrazione e modelli verticali. L’evoluzione dei modelli Llm ridefinisce quindi non solo l’efficienza tecnica, ma anche l’intero modello economico della GenAI. Il 2030 rappresenta un punto di arrivo e, allo stesso tempo, l’inizio di una fase nuova, in cui l’intelligenza avanzata sarà accessibile solo a chi saprà costruire architetture solide e sostenibili.