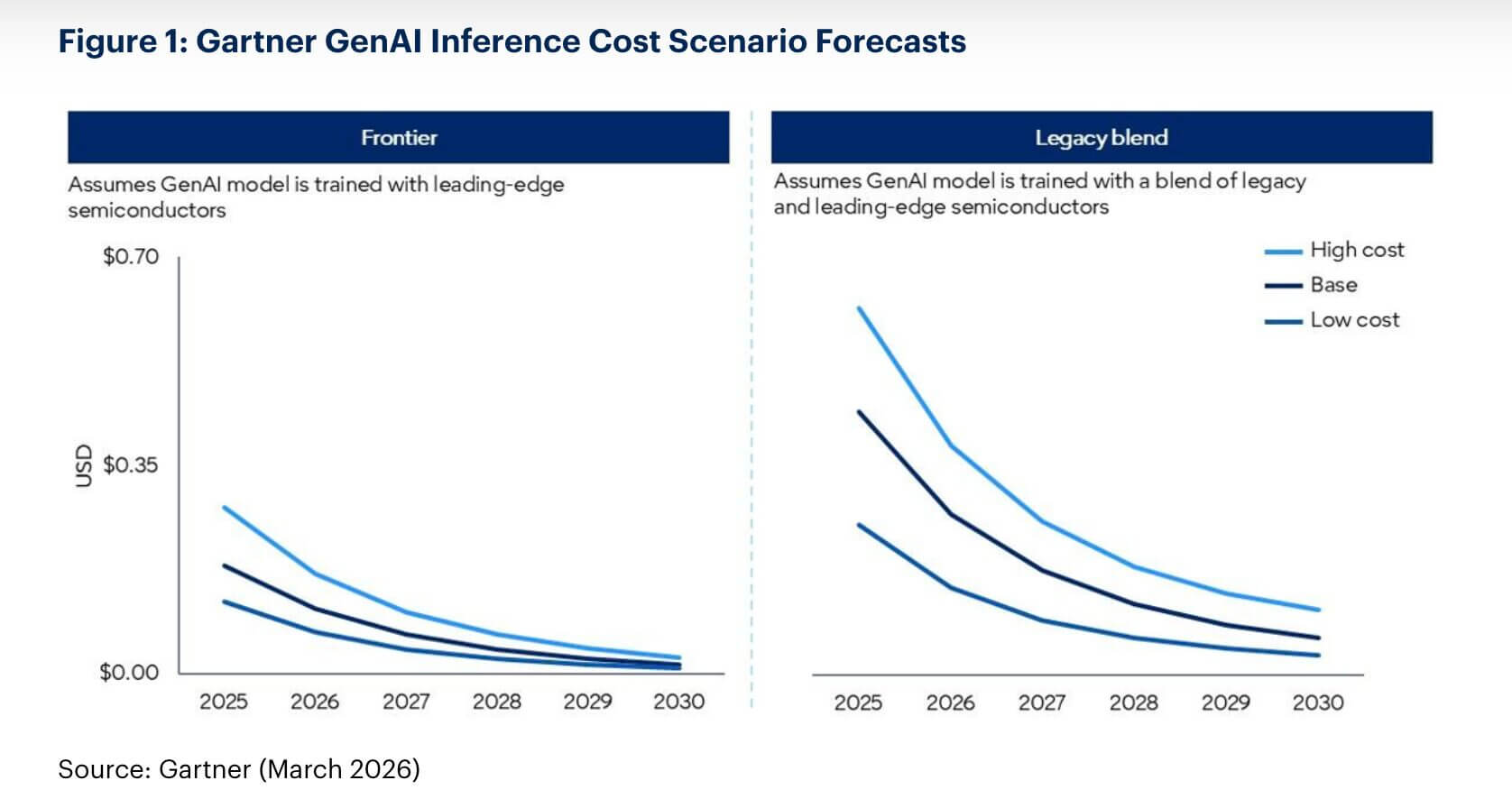

Una nuova analisi sui modelli Llm pubblicata da Gartner segna un passaggio decisivo nella maturità della GenAI. Entro il 2030, secondo l’istituto, l’inferenza di un modello da un trilione di parametri costerà oltre il novanta per cento in meno rispetto al 2025. Il dato sembra segnare una svolta, eppure nasconde un cambio di paradigma più profondo. L’ecosistema non si muove soltanto verso l’efficienza, ma verso un nuovo equilibrio tra risorse computazionali, architetture flessibili e una domanda di potenza di calcolo destinata ad aumentare più del previsto. Il punto non è il costo unitario dei token, quanto la quantità di elaborazione richiesta dai sistemi più sofisticati.

l’analisi

Modelli LLM, costi di inferenza giù del 90% entro il 2030

L’evoluzione dei semiconduttori e dei chip dedicati riduce i costi, ma l’aumento dei token e dei sistemi agentici spinge verso nuovi modelli di orchestrazione. Le rilevazioni di Gartner

Continua a leggere questo articolo

Aziende

Argomenti

Canali