La domanda che attraversa oggi il settore delle telecomunicazioni non è più soltanto “dove mettere i server”, ma dove far vivere davvero la potenza di calcolo necessaria a sostenere l’ondata di intelligenza artificiale. Si tratta di una questione strategica dato che la collocazione dell’infrastruttura determina tempi di risposta, sovranità del dato, modelli di partnership e – soprattutto – ritorni economici. Il tema è al centro nel “Telco AI data centre forecast” di STL Partners secondo cui entro il 2030 la capacità complessiva di calcolo “telco-operated” legata a due filoni – AI factory e network edge – arriva a 3.612 MW, oltre 3,5 GW, ma la crescita non sarà affatto simmetrica.

Indice degli argomenti

I numeri della capacità: oltre 3,5 GW entro il 2030

Il forecast di STL Partners fotografa due opportunità infrastrutturali distinte per i carrier: da un lato i siti di edge computing nella rete, pensati per servizi a bassa latenza; dall’altro le AI factory, cioè data center centralizzati costruiti “a misura” di workload di intelligenza artificiale. Questo doppio binario nasce dalla trasformazione della domanda enterprise: serve calcolo per addestrare e rifinire i modelli, ma serve anche calcolo “vicino” al punto in cui i dati vengono generati o consumati.

La divergenza, però, sta nei volumi. Nel 2030 le AI factory peseranno la parte nettamente prevalente della capacità complessiva: il report stima che le telco costruiranno 27 volte più capacità nelle AI factory rispetto al network edge. Non è solo una questione di “moda AI”: è anche un tema di scala minima efficiente. Le AI factory concentrano enormi densità di potenza e GPU in pochi siti, mentre l’edge richiede una costellazione di strutture più piccole e capillari, che hanno senso economico solo con una domanda già matura.

Singh: ritorni più chiari nelle AI factory

Per capire perché il “centro” stia vincendo la prima fase della partita bisogna guardare alla natura dell’hardware e al tipo di servizi vendibili. Le AI factory hanno un’architettura centralizzata e in molti casi si riducono a uno o due grandi siti per Paese; nei progetti greenfield si superano spesso le 20 GPU per rack e le densità oltre 40 kW, con impianti che possono andare da 5 MW fino a “oltre un GW” di IT load complessivo. In altre parole: è un mondo più vicino all’hyperscale, con tutte le implicazioni su capitali, contratti e governance operativa.

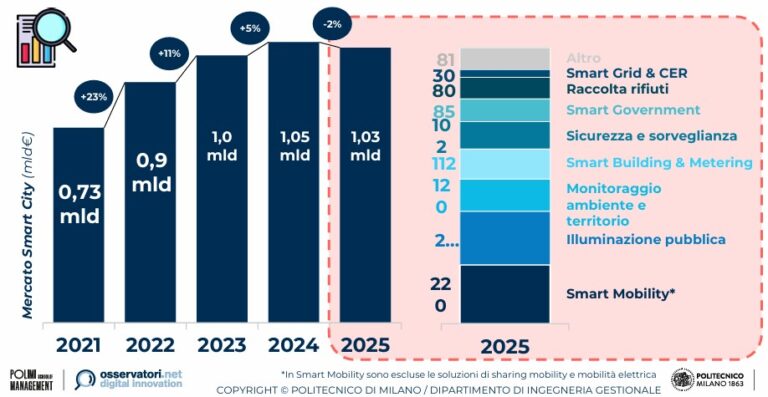

“In definitiva, le telco stanno investendo nelle AI factory perché si aspettano di ottenere, nei prossimi anni, rendimenti dell’investimento più elevati rispetto ai data center edge di rete. Le AI factory supportano l’addestramento dei modelli, il fine-tuning e l’inferenza su larga scala, servendo più livelli dell’ecosistema dell’IA. Al contrario, i siti edge continueranno ad avere un ruolo, ma soprattutto per casi d’uso mirati, su aree estese e a bassa latenza, come i trasporti e le smart city”, spiega Krsna Singh, Research Analyst e co-autore del forecast.

Il punto è che l’AI factory si presta a essere una piattaforma “multi-livello”: training, fine-tuning, inferenza su larga scala possono convivere e alimentare una domanda più ampia e continuativa. Il report segnala anche un’accelerazione misurabile: la capacità globale delle AI factory telco passerebbe da 142 MW nel 2024 a 3.483 MW nel 2030, con una crescita indicata come “25x”.

Dal network edge pionieristico al rilancio post-2025

L’altra faccia della medaglia, il network edge, continua a essere evocata come tassello strategico, ma con una crescita più misurata. Nel forecast, la capacità edge globale sale da 86 MW nel 2024 a 129 MW nel 2030, con un CAGR “modesto” del 7%, mentre il numero di siti passa da 761 a 1.595. L’edge non sparisce, ma non diventa la “fabbrica” principale della potenza di calcolo telco nel breve periodo.

Eppure l’edge non parte da zero. Già entro il 2022 il mercato aveva visto una prima ondata di early mover, spesso in logica di alleanza con i grandi cloud: partnership AWS Wavelength e iniziative con Azure ricorrono in diversi casi, e compaiono nomi come KDDI, Verizon, China Telecom, Singtel, NTT DoCoMo, SoftBank, oltre a operatori nordamericani ed europei.

L’analisi aggiunge un dettaglio importante di cronaca industriale: dopo una fase di stagnazione, l’edge starebbe mostrando un rinnovato slancio, con diversi grandi operatori che “since 2025” hanno lanciato nuove proposizioni. La dinamica, in sostanza, sembra quella tipica delle tecnologie “abilitanti”: una prima ondata spinta dall’entusiasmo e dalle partnership, una frenata quando i casi d’uso non monetizzano abbastanza, e una ripartenza quando il contesto – oggi, l’AI – rende più chiaro dove l’edge può davvero fare la differenza.

Federazione europea e piattaforme davvero differenziate

La domanda, però, resta brutale: l’edge telco è davvero più “vicino” del cloud? In molti mercati, osserva STL Partners, i servizi edge non offrono una prossimità superiore rispetto alle infrastrutture cloud esistenti e, soprattutto, esprimono una capacità totale limitata. Se la piattaforma non risulta chiaramente differenziante, l’edge rischia di diventare un “cloud più piccolo” con margini più complessi.

Qui entra in gioco il tema della federazione, particolarmente rilevante in Europa: l’idea è unire la frammentazione geografica e commerciale per presentare al mercato enterprise un’offerta più ampia e coerente. Ma Singh avverte che non basta la governance se manca la massa critica infrastrutturale: “I tentativi di creare una federazione del network edge in Europa possono essere d’aiuto, ma la federazione può avere successo solo dove, in primo luogo, esiste un’infrastruttura edge sufficiente da federare”, aggiunge Singh.

Detta altrimenti, la federazione può diventare un moltiplicatore solo se esiste già un “minimo sindacale” di siti, capacità e standard tecnici condivisi. È un passaggio cruciale: senza scala, l’edge resta un mosaico di iniziative locali; con scala, può diventare un vero strato industriale per inferenza a bassa latenza e per applicazioni che non possono “andare lontano” con i dati.

Est Asia laboratorio: tre modelli di AI factory

Se l’edge fatica a trovare una crescita esplosiva, il report indica che la corsa alle AI factory accelera soprattutto in East Asia & Pacific: molta della capacità sarebbe trainata da lanci precoci e numerosi nell’area e il 2028 viene indicato come punto di inflessione, quando la capacità globale inizia a scalare più rapidamente, con gli operatori che passano dalle prime fasi a espansioni più solide.

Il testo fornito aggiunge una tassonomia utile, perché mostra che non esiste un solo modo di essere “AI factory telco”. Si delineano tre modelli: c’è chi, come Iliad, guarda a impianti più piccoli focalizzati su inferenza locale e fine-tuning; chi, come SK Telecom, punta all’intero ciclo di vita dell’AI, dal training al deployment, sostenuto da investimenti di calcolo più consistenti; e poi un terzo gruppo – con China Telecom citata come esempio – che combina AI factory e siti edge per offrire un portafoglio più ampio di hosting per workload enterprise.

Questo terzo modello è interessante anche perché risuona con un passaggio chiave del forecast: le decisioni di investimento, nella pratica, sono “interconnected” e in alcuni mercati le due layer risultano complementari, con AI factory per training/fine-tuning/inferenza centralizzata e edge per inferenza low-latency. La sintesi è evidente: non è un aut-aut tecnologico, ma un problema di priorità, tempi e capitale.

Sovranità, investimenti a fasi e alleanze con i vendor

A spingere molte iniziative non è solo la corsa all’efficienza, ma anche la geopolitica dei dati: sovranità, conformità, controllo domestico delle infrastrutture. È qui che le telco possono rivendicare un vantaggio “da campione nazionale”, ma senza ripetere gli errori già visti nelle prime roll-out edge.

“Poiché le preoccupazioni legate alla sovranità stanno guidando una quota significativa delle implementazioni di AI factory, le telco sono ben posizionate, come campioni nazionali, per capitalizzare questa opportunità. Tuttavia, devono adottare un approccio incrementale nella costruzione della capacità – sottolinea Singh – Scaglionare gli investimenti aiuta a gestire il rischio sul capitale ed evita i problemi di sovradimensionamento visti nelle prime implementazioni del network edge, quando la domanda non era ancora matura. Dal momento che le AI factory richiedono ingenti capitali e sono complesse da gestire sul piano operativo, le telco hanno inoltre bisogno di strategie di partnership chiare con i vendor tecnologici e con gli specialisti dei data center, come i NVIDIA Cloud Partners”.

La questione va dunque affrontata su due fronti. Da una parte disciplina finanziaria: costruire per fasi per non ritrovarsi con capacità inutilizzata. Dall’altra disciplina industriale: l’AI factory è complessa da gestire, e richiede alleanze chiare con vendor e specialisti di data center. La posta in gioco è alta perché, se i numeri del forecast si avverano, il baricentro del valore – e del potere contrattuale – si sposterà verso chi controlla le infrastrutture che abilitano training e inferenza su scala.