Le Ran native AI offrono agli operatori la possibilità di sfruttare l’immenso potenziale dell’intelligenza artificiale per migliorare gli aspetti economici associati alla rete di accesso radio, espandendone al contempo le capacità operative per fornire una spinta quanto mai necessaria a un settore che fatica a far crescere il fatturato.

Il percorso è impegnativo: non solo i costi iniziali rappresentano un ostacolo sostanziale per molti operatori, ma esiste anche il rischio di gravi interruzioni causate dall’introduzione di funzioni di intelligenza artificiale nello stesso ambiente di elaborazione delle funzioni Ran. di Analysys Mason fornisce una risposta a queste sfide nel suo report “AI-native Ran: implementation strategies”.

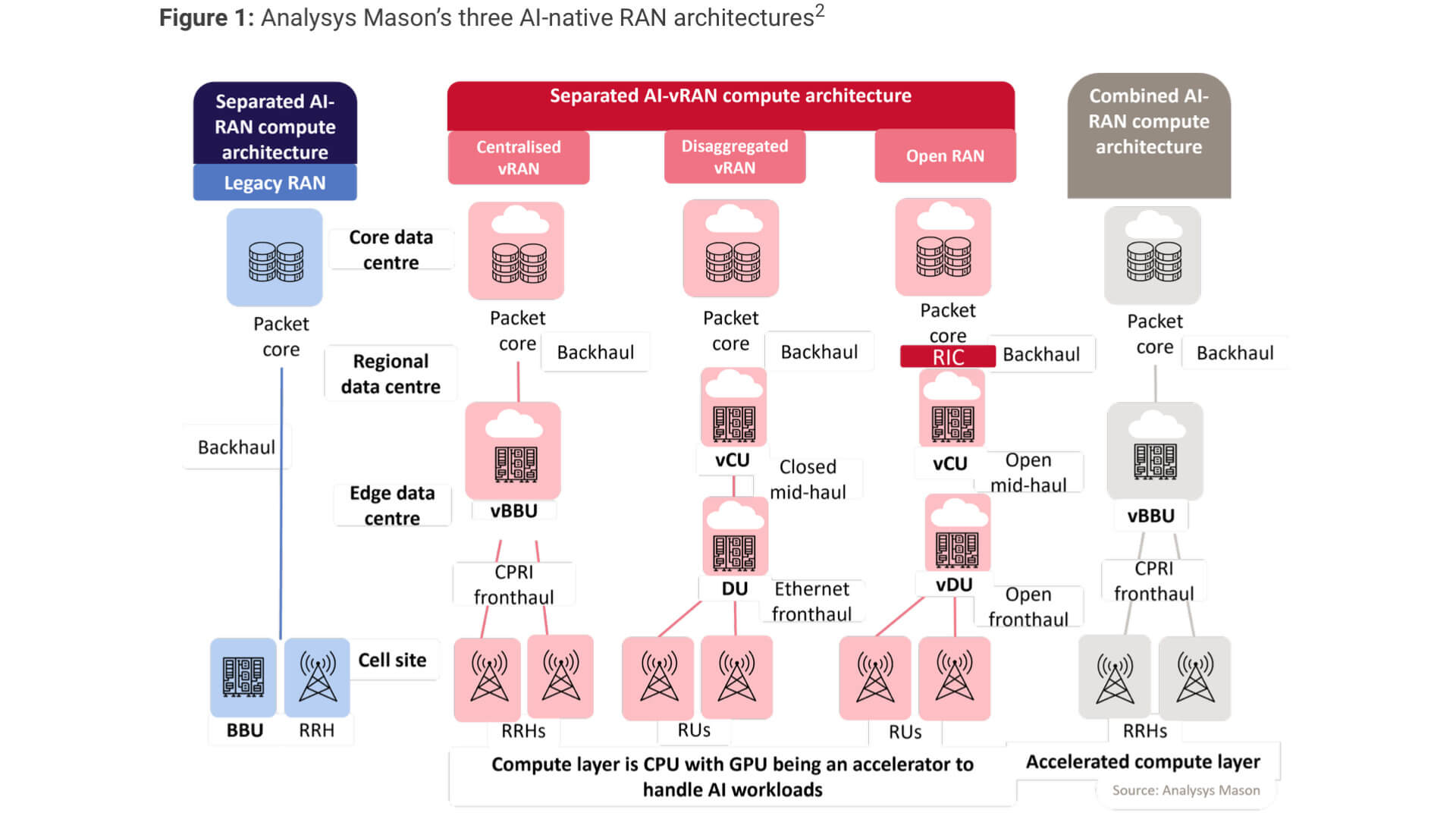

Lo studio illustra tre strategie di implementazione della rete di accesso radio nativamente basata sull’Ai che offrono agli operatori la flessibilità necessaria per avviare il loro percorso verso la Ran Ai-native con tempistiche adatte ai loro obiettivi aziendali e con un percorso di migrazione semplice dalle Ran esistenti alle nuove architetture.

Indice degli argomenti

AI-native Ran, superare le sfide per realizzare le opportunità

Per realizzare i vantaggi delle Ran native Ai (maggiore efficienza, costi inferiori), gli operatori devono comprendere quali cambiamenti debbano essere apportati agli ambienti Ran esistenti per consentire la migrazione alla nuova architettura, nonché l’impatto di tali cambiamenti sulle implementazioni Ran esistenti.

Un cambiamento fondamentale necessario per la migrazione è l’inclusione di unità di elaborazione grafica (Gpu), ovvero i processori più comuni per l’esecuzione di intelligenza artificiale avanzata come i modelli Llm, nelle apparecchiature Ran esistenti.

Le preoccupazioni degli operatori su costi e prestazioni

Un recente sondaggio di Analysys Mason condotto su 67 operatori in tutto il mondo sui loro piani futuri per l’architettura di rete di accesso radio evidenzia le preoccupazioni sugli elevati costi iniziali per l’acquisizione o l’accesso alle Gpu, il significativo consumo energetico di questi processori Ai e i costi e i compromessi prestazionali che potrebbero derivare dalla gestione di carichi di lavoro Ai e Ran all’interno dello stesso ambiente.

Queste preoccupazioni potrebbero rallentare il ritmo della transizione e impedire di sfruttarne i benefici. Tuttavia, secondo Analysys Mason, gli operatori devono da subito agire definendo una roadmap verso la Ran AI-native, perché è probabile che le future reti 6G si baseranno su questa architettura. La strategia giusta per la transizione è quella che riduce al minimo i rischi.

Tre modelli di implementazione per le telco

L’obiettivo finale nella pianificazione di una rete di accesso radio Ai-native è una rete di accesso radio virtualizzata (vRan) cloud-native e definita tramite software, in esecuzione su un’architettura di elaborazione che supporti sia la Ran che l’accelerazione tramite intelligenza artificiale. Pertanto, il punto di partenza per qualsiasi architettura Ran nativa AI deve essere una vRan. Tuttavia, la maggior parte degli operatori non ha implementato commercialmente la vRan e deve valutare fino a che punto può ottenere alcuni vantaggi della Ai-Ran pur disponendo ancora di una Ran convenzionale. Anche quelli che hanno implementato la vRan potrebbero essere restii ad evolvere.

Perciò Analysys Mason ha identificato tre modelli di implementazione che gli operatori possono adottare, a seconda della loro Ran attuale, e di cui illustra pro e conto. Ognuno di questi modelli ha una diversa architettura di elaborazione che supporta l’elaborazione tramite intelligenza artificiale. Si tratta di: l’architettura di calcolo AI-Ran combinata, l’architettura di calcolo AI-Ran separata e l’architettura di calcolo AI-vRAN separata.

Pro e contro delle strategie per l’Ai-native Ran

L’Ai-Ran separata applica il controllo Ai-Ran a una rete di accesso radio tradizionale esistente, con applicazioni Ai e Ran in esecuzione su piattaforme di calcolo separate. Questo primo passo faciliterà la transizione degli operatori alla Ran Ai-nativa basata perché non interrompe le operazioni Ran esistenti e richiede costi iniziali inferiori rispetto alle altre due strategie. Tuttavia, i costi iniziali inferiori rappresentano un vantaggio a breve termine, poiché l’esecuzione di due architetture comporterà maggiori costi operativi, complessità e sfide di integrazione.

Gli operatori già con implementazioni vRan possono scegliere tra due opzioni: l’architettura di elaborazione AI-vRan separata e l’architettura di elaborazione AI-Ran combinata. La decisione dipenderà dalla maturità della vRan dell’operatore e dalla sua disponibilità ad aumentare gli investimenti.

L’architettura AI-vRan separata consente la coesistenza tra una vRan esistente e una Ran incentrata sull’Ai. Le funzioni di rete Ran verranno eseguite nell’ambiente di elaborazione esistente, mentre le applicazioni di Ai verranno eseguite in un ambiente di elaborazione separato, con acceleratori di Ai dedicati. I principali vantaggi di questa strategia sono una transizione ben pianificata alla Ran AI-nativa, senza sprecare i recenti investimenti in vRan, e la flessibilità di mappare le risorse di elaborazione Ran e Ai sulla topologia di rete esistente. Tuttavia, questa strategia comporta un rischio elevato in termini di costi, dati i costi generali di gestione e armonizzazione di due piattaforme separate.

L’architettura Ai-Ran combinata sarà completamente basata su software e cloud-native. Le applicazioni Ran e Ai funzioneranno sulla stessa piattaforma di calcolo, con un’accelerazione che combina le sofisticate capacità di elaborazione della Gpu con la Cpu e altri chipset rilevanti necessari per gestire carichi di lavoro sia Ai che Ran.

Questa architettura offre agli operatori l’opportunità di ottimizzare le proprie prestazioni Ran, prepararsi al 6G e svolgere il proprio ruolo nel soddisfare la crescente domanda di funzionalità Ai da parte di consumatori e aziende. Tuttavia, il costo dell’adozione dell’approccio combinato Ai-Ran è superiore a quello delle altre strategie nel breve termine e, laddove l’elaborazione Ai è relativamente centralizzata, sarà necessaria una connettività in fibra di alta qualità per collegare i siti cellulari alle bande base centrali native dell’Ai.

La prossima sfida: l’ecosistema deve crescere

Disporre di più opzioni di implementazione dell’Ai-Ran consente agli operatori di sviluppare una roadmap di transizione verso un ambiente Ran completamente nativo per l’intelligenza artificiale, in linea con le loro reti e i loro obiettivi.

Tuttavia, la flessibilità che gli operatori ottengono da queste opzioni di implementazione crea un’enorme richiesta per tutto l’ecosistema che ruota intorno alla rete di accesso radio, concludono gli analisti. I fornitori di Ran, gli integratori di sistema e il resto dell’ecosistema devono essere preparati a supportare una qualsiasi delle tre strategie, dati i diversi livelli di maturità degli operatori.

Questi attori dovrebbero essere il più flessibili possibile nell’offrire ai clienti e ai potenziali operatori diversi progetti per Ran Ai-native, in linea con le priorità di rete e aziendali degli operatori. E dovrebbero essere preparati anche a supportare la transizione degli operatori da una strategia di implementazione all’altra nel tempo.