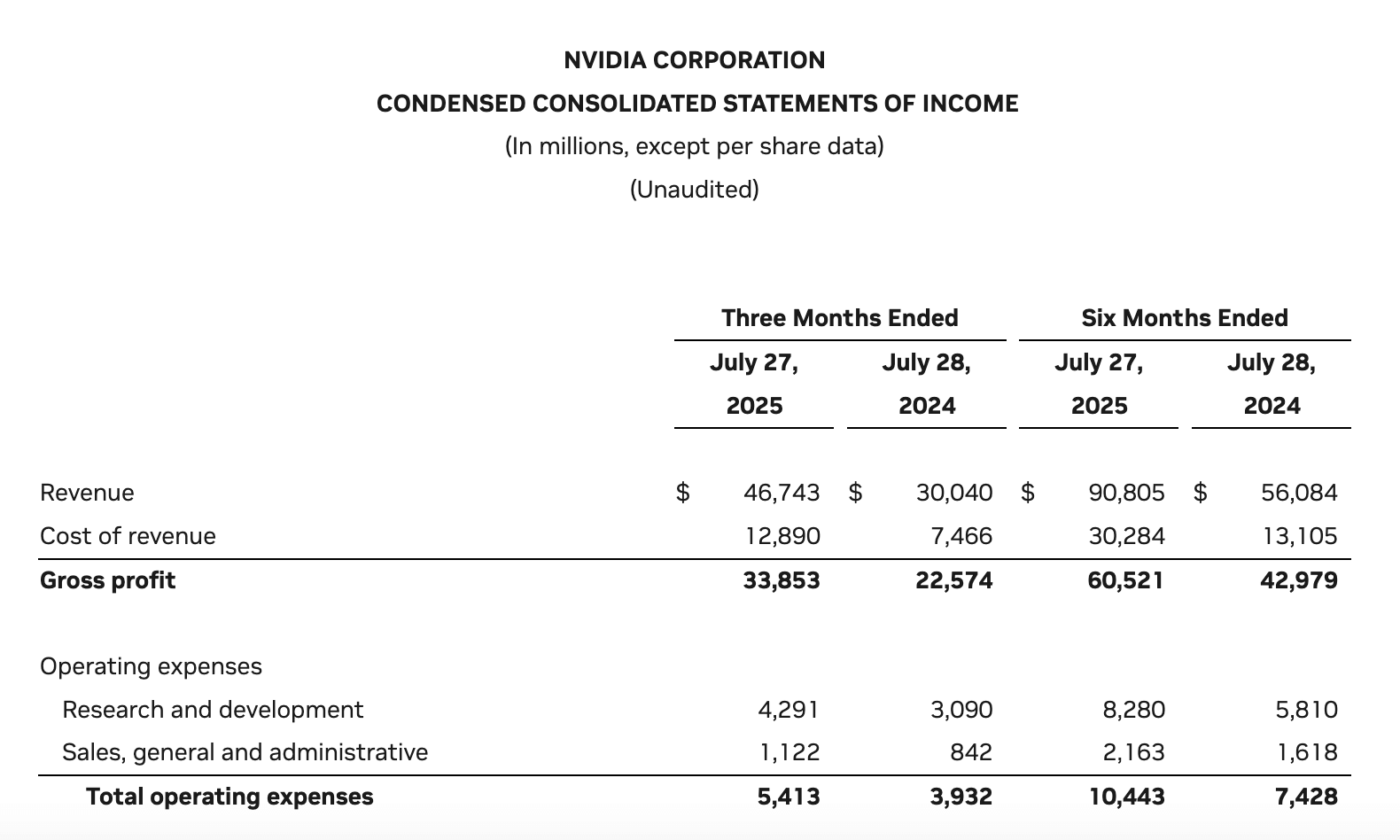

La trimestrale di Nvidia per il secondo trimestre fiscale 2026 si chiude con numeri da primato: 46,7 miliardi di dollari di ricavi complessivi, in crescita del 6% rispetto al trimestre precedente e del 56% su base annua. Ma è il comparto networking a catalizzare l’attenzione degli analisti e degli operatori del settore telco. Con 7,3 miliardi di dollari di ricavi, il segmento registra un incremento del 98% rispetto allo stesso periodo dell’anno precedente, confermandosi come leva strategica per la scalabilità dell’intelligenza artificiale.

Il ceo Jensen Huang ha dichiarato che “il networking è diventato il cuore pulsante delle AI factories”, ambienti distribuiti ad altissima intensità computazionale. “Con NVLink 72 e Spectrum-X, stiamo ridefinendo la velocità e l’efficienza energetica della generazione AI”, ha aggiunto, sottolineando come la rete non sia più un semplice canale di trasporto, ma un elemento attivo del processo computazionale.

Indice degli argomenti

Spectrum-XGS, la rete intelligente per i data center AI

Al centro della crescita del networking Nvidia c’è Spectrum-XGS, evoluzione della piattaforma Ethernet AI Spectrum-X. Questa architettura integra switch SN5600, Dpu BlueField-3 e ConnectX-8 SuperNICs, adattatori da 800 Gb/s progettati per ambienti AI multi-tenant. L’obiettivo è chiaro: trasformare data center isolati in AI super factories, capaci di collaborare in tempo reale su modelli generativi di nuova generazione.

La nuova versione introduce algoritmi di controllo adattivo della congestione, telemetria avanzata e gestione della latenza, elementi chiave per la connessione tra data center distribuiti. Nvidia afferma che Spectrum-XGS raddoppia le performance della Nvidia Collective Communications Library (Nccl) e offre 1,6 volte la densità di banda rispetto all’Ethernet tradizionale. Questo si traduce in una efficienza operativa che rende il networking “virtualmente gratuito”, come ha dichiarato Huang: “Il ritorno sull’investimento è tale da rendere il costo della rete trascurabile rispetto ai benefici ottenuti”.

Nvidia e la trasformazione del modello infrastrutturale

Il successo del networking Nvidia si inserisce in una strategia più ampia, che punta a trasformare ogni data center in una AI factory. Oltre ai chip Blackwell e alle GPU H200, Nvidia ha lanciato servizi come Dgx Cloud, AI Foundry e Nim microservices, pensati per accelerare lo sviluppo e la distribuzione di modelli generativi. Questi ambienti richiedono infrastrutture di rete ad altissima capacità, capaci di gestire flussi di dati in tempo reale e con latenza minima.

In questo scenario, la banda ultralarga diventa un elemento abilitante. Le soluzioni Spectrum-Xgs si integrano perfettamente con le reti ad alta capacità, rendendo possibile la creazione di ambienti AI distribuiti e interconnessi.

La convergenza tra hardware, software e networking rappresenta il nuovo paradigma infrastrutturale. Nvidia non si limita a fornire componenti, ma propone una piattaforma integrata che abbraccia tutto lo stack AI, dalla formazione dei modelli alla loro distribuzione su scala globale.

Impatti sul settore telco e prospettive future

La crescita del networking Nvidia ha implicazioni dirette per il settore telco, chiamato a ripensare le proprie infrastrutture in chiave AI. La domanda di reti ad altissima capacità, bassa latenza e gestione intelligente del traffico è destinata a crescere esponenzialmente, spinta dalla diffusione di modelli generativi e ambienti cloud distribuiti.

Gli operatori di rete, i fornitori di servizi cloud e i system integrator si trovano di fronte a una trasformazione radicale. La rete non è più un costo da contenere, ma una leva di valore per la scalabilità, l’efficienza e la sostenibilità delle architetture AI. La visione di Nvidia, che punta a trasformare ogni data center in una AI factory, apre scenari inediti per la progettazione e la gestione delle infrastrutture di rete.

In questo contesto, il networking diventa un asset strategico per l’intero ecosistema digitale. Le soluzioni come Spectrum-Xgs e NVLink 72 non solo migliorano le performance, ma abilitano nuove forme di collaborazione tra data center, accelerano la formazione dei modelli AI e riducono i costi operativi. Un’evoluzione che potrebbe ridefinire le priorità di investimento nel settore telco nei prossimi anni.

L’orizzonte dell’AI distribuita e il ruolo di Nvidia

Il futuro dell’intelligenza artificiale è distribuito, scalabile e interconnesso. Nvidia sta costruendo le fondamenta di questo futuro, non solo con chip e Gpu, ma con un’infrastruttura di rete pensata per l’AI generativa. La crescita del comparto networking nella trimestrale non è un dato isolato, ma il segnale di una trasformazione profonda che coinvolge tutta la filiera tecnologica.

La capacità di Nvidia di integrare hardware, software e networking in un’unica piattaforma rappresenta un vantaggio competitivo decisivo. In un mondo dove la velocità di elaborazione, la latenza e l’efficienza energetica sono fattori critici, il networking diventa la chiave per sbloccare il potenziale dell’AI su larga scala.

Per il settore telco, questo significa ripensare modelli di business, architetture di rete e strategie di investimento. La sfida è cogliere le opportunità offerte da questa nuova infrastruttura, trasformando la rete da semplice supporto a motore dell’innovazione digitale.