L’on-device AI si afferma come nuova direttrice dell’intelligenza artificiale distribuita. Non è un semplice spostamento tecnico, ma una trasformazione strutturale che coinvolge smartphone, auto, dispositivi domestici e industriali e, soprattutto, il modo in cui gli operatori di rete potranno generare valore. Uno studio di Gsma Intelligence fotografa questo passaggio con chiarezza: l’elaborazione locale non sostituisce il cloud, ma ridisegna la geografia dei carichi, aprendo una fase in cui il dispositivo diventa il primo nodo intelligente della catena.

La logica è semplice: elaborare in locale riduce latenza, migliora la privacy e permette un controllo diretto dei dati sensibili. È un ribaltamento del paradigma centralizzato che ha dominato l’ultimo decennio. I dispositivi assumono un ruolo più avanzato, supportati da SoC che integrano acceleratori dedicati, memoria ad alta velocità e capacità di inferenza sempre più sofisticate.

Indice degli argomenti

Privacy, prestazioni e nuovi use case: perché l’on-device accelera

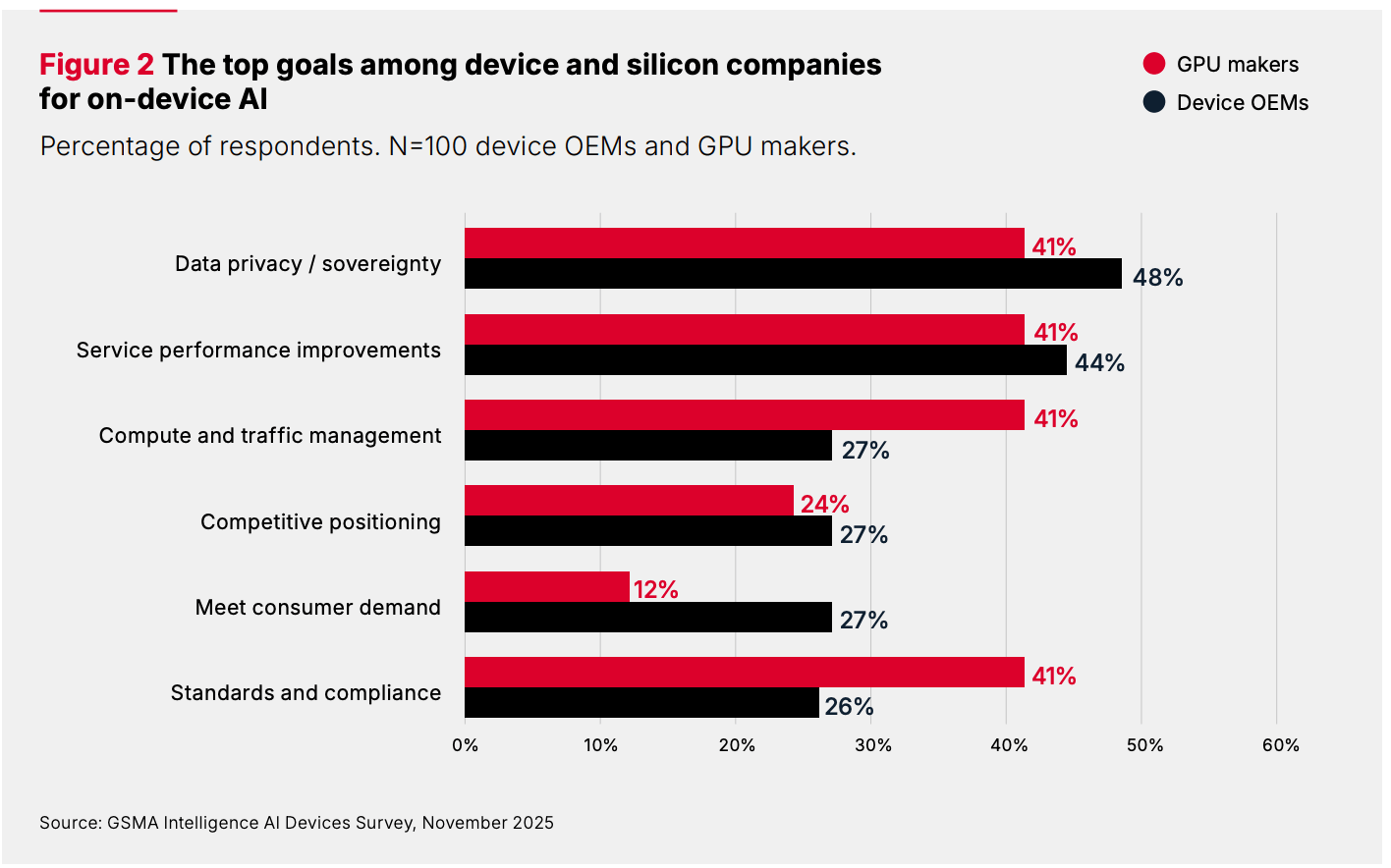

Tra le ragioni che spingono l’on-device AI, privacy e sovranità dei dati emergono come fattori determinanti. Le aziende vogliono ridurre i passaggi verso infrastrutture esterne, mentre gli utenti chiedono servizi più rapidi e affidabili. È da questo equilibrio che nasce un ventaglio di casi d’uso destinati a diffondersi rapidamente.

Nel segmento consumer, i produttori puntano su ricerca intelligente, protezione dei dati personali, raccomandazioni contestuali, salute digitale e assistenza evoluta. Nel mondo enterprise l’interesse converge su analitiche predittive, visione artificiale e ottimizzazione energetica. Si tratta di scenari che beneficiano della capacità di elaborare nel punto in cui il dato viene generato, senza passaggi intermedi.

Lo smartphone resta il fulcro di queste trasformazioni, seguito da Pc, smart home e automotive. L’avanzata di cockpit intelligenti e occhiali con funzioni di realtà aumentata conferma che la priorità non è la rivoluzione delle forme, ma la potenza computazionale distribuita.

Silicio e sistemi: Npu, memoria e quantizzazione al centro

La crescita dell’on-device è possibile perché il silicio cambia. Le nuove generazioni di SoC superano la logica centrata su Cpu e Gpu attraverso un’architettura eterogenea in cui la Npu diventa l’unità principale per l’inferenza. È ottimizzata per compiti paralleli e intensivi, con un rapporto prestazioni-consumi adatto a dispositivi senza raffreddamento attivo.

La memoria costituisce il secondo pilastro. L’adozione diffusa di LPDDR5X garantisce la banda necessaria ad alimentare i modelli di AI, mentre le gerarchie di cache riducono la distanza tra acceleratori e dati. Cresce anche la necessità di ottimizzare il footprint dei modelli: la quantizzazione, soprattutto nei formati Int8 e Int4, riduce drasticamente le dimensioni e accelera l’esecuzione. Senza queste tecniche, i modelli generativi non potrebbero funzionare su dispositivi compatti.

Resta il nodo fisico del calore. I dispositivi passivamente raffreddati devono gestire la temperatura attraverso il throttling, che limita le prestazioni reali. Per questo i produttori orientano lo sviluppo verso architetture che garantiscono prestazioni sostenute, più che picchi di potenza.

Casi d’uso: cosa può stare sul device e cosa resterà ibrido

Lo studio evidenzia che gli attuali SoC di fascia alta sono già sufficienti per realtà virtuale, smart glasses e analisi visiva. In questi ambiti l’inferenza locale offre vantaggi immediati, dalla riduzione della latenza alla maggiore autonomia applicativa.

Diversa la situazione per i casi d’uso più complessi, come l’AI-based search. La potenza necessaria per gestire modelli ampi e throughput elevati impone una collaborazione continua con il cloud o con nodi edge. Per molte applicazioni, quindi, il futuro sarà ibrido: il dispositivo gestirà la parte interattiva, mentre l’elaborazione più pesante rimarrà centralizzata.

L’equilibrio varierà in funzione dell’intensità del workload. È evidente però che l’on-device diventa una componente essenziale per l’esperienza utente in scenari che richiedono immediatezza o elaborazione sensibile.

Telco: rischi e opportunità tra edge e orchestrazione

L’on-device AI ha un impatto diretto sul settore telco. L’inferenza locale può ridurre parte del traffico verso il cloud, con conseguenze sui ricavi da trasporto. Al tempo stesso, l’aumento di uplink generato da video, contenuti creati dagli utenti e applicazioni AI può far crescere i volumi complessivi.

Gli operatori si trovano quindi a un bivio strategico. Da una parte devono mitigare la possibile erosione del traffico, dall’altra hanno l’opportunità di creare nuove linee di business. Gli investimenti in edge compute, già in forte accelerazione, consentono di avvicinare la potenza di calcolo agli utenti finali e di proporre servizi di elaborazione e orchestrazione dei carichi AI.

La capacità di decidere in tempo reale dove eseguire l’inferenza (sul device, sull’edge o sul cloud) diventerà un servizio di valore. Da qui derivano modelli come compute-as-a-service, offerte di calcolo localizzato con garanzie di sovranità e soluzioni integrate che combinano slicing e capacità edge a consumo.

La crescita delle implementazioni AI nei data center degli operatori indica che il settore sta già preparando le fondamenta per questo passaggio.

Geografie diverse, maturità diverse

Le priorità variano per regione. In Asia prevale la necessità di ridurre i consumi energetici, in Europa l’urgenza resta il completamento delle infrastrutture 5G, mentre negli Stati Uniti la competizione si gioca sulla capacità dei data center. Il pieno sviluppo dell’on-device dipenderà quindi non solo dai progressi tecnologici, ma anche dal contesto regolatorio e dagli incentivi locali.

La traiettoria futura: dal device cloud al nuovo ruolo delle telco

L’evoluzione successiva punta verso il device cloud personale, un ambiente in cui smartphone, auto, occhiali e nodi edge cooperano attraverso orchestrazione intelligente. I dispositivi condividono carichi e contesto, ottimizzando prestazioni, consumi e continuità dei servizi.

Perché questa visione si realizzi, servono tre fattori: chiudere i gap su Gpu, Ram, sicurezza ed efficienza; consolidare la toolchain per sviluppatori; rafforzare il ruolo degli operatori nell’erogazione di calcolo a bassa latenza e nella gestione del contesto applicativo.

Se questi tasselli si compongono, l’on-device AI non sarà solo un’evoluzione tecnologica ma un’opportunità industriale. Potrà valorizzare gli investimenti in 5G, riqualificare le reti come piattaforme di intelligenza distribuita e ridisegnare il perimetro competitivo del settore telco.