Negli ultimi anni l’Intelligenza Artificiale è passata da promessa tecnologica a leva strategica per il business, catalizzando investimenti, sperimentazioni e un acceso dibattito pubblico. Tuttavia, dopo una prima fase di entusiasmo, molte organizzazioni sembrano oggi trovarsi in una condizione ambivalente: da un lato un’apparente fase di plateau nell’estrazione di valore, dall’altro un continuo emergere di nuovi paradigmi — come l’agentic AI — che ridefiniscono rapidamente lo scenario competitivo.

In questo contesto in evoluzione, tra aspettative elevate e difficoltà di implementazione concreta, abbiamo intervistato Antonio Pescapè, Professore Ordinario di Reti di Calcolatori e di Data Analysis and Cybersecurity presso l’Università di Napoli Federico II, per comprendere quali siano i veri fattori che stanno rallentando il pieno successo dell’IA e quale direzione dovrebbero intraprendere le organizzazioni.

Professore, dopo anni di entusiasmo sull’intelligenza artificiale, molte aziende sembrano oggi incontrare difficoltà nel tradurre il potenziale in valore concreto. Siamo davvero entrati in una fase di rallentamento?

Più che di rallentamento parlerei di una fase di maturazione, che però si manifesta come un plateau apparente. La realtà è che stiamo vivendo una tensione tra due dinamiche opposte: da un lato le organizzazioni faticano a estrarre valore sistemico dall’IA, dall’altro la tecnologia continua a evolvere rapidamente, introducendo nuovi paradigmi prima ancora che i precedenti si siano consolidati. Questo “moving target” genera una sorta di paralisi decisionale. Le aziende aspettano stabilità, ma nel frattempo non sviluppano le capacità interne necessarie. Il limite, quindi, non è solo tecnologico, ma anche progettuale e organizzativo.

Uno dei temi più discussi riguarda le aspettative spesso troppo elevate sull’IA generativa. Quanto pesa, secondo lei, una scarsa comprensione delle sue reali potenzialità?

Pesa moltissimo. C’è stata una sovrastima iniziale accompagnata da una comprensione ancora superficiale. È fondamentale chiarire un punto: i modelli di IA generativa, in particolare gli LLM, sono sistemi che producono plausibilità linguistica, non verità. Non restituiscono un output “corretto” in senso deterministico, ma un output probabilisticamente corretto, sulla base dei pattern appresi nei dati. Questo li rende straordinariamente efficaci in contesti come la generazione di contenuti, la sintesi o l’interazione, ma meno adatti in scenari dove è richiesta precisione rigorosa o verificabilità formale. Inoltre, esiste una certa confusione tra ciò che può fare la GenAI e ciò che invece continua a essere svolto meglio dal machine learning classico. Task come inferenza strutturata, predizione quantitativa o classificazione su dati ben definiti sono spesso più efficienti, affidabili e controllabili con approcci tradizionali. Il vero problema, quindi, non è la tecnologia in sé, ma il “task design”: capire quale strumento usare per quale problema. Finché questa distinzione non sarà chiara, continueremo a vedere aspettative disallineate e risultati inferiori al potenziale.

Un altro elemento che emerge è la tendenza a utilizzare l’IA per migliorare l’esistente, piuttosto che per creare qualcosa di nuovo. È un limite culturale?

Assolutamente sì. Oggi l’IA viene spesso utilizzata come un “boost” applicato a processi esistenti, migliorandone l’efficienza ma senza metterne in discussione la struttura. Questo approccio genera benefici incrementali, ma raramente porta a un vero vantaggio competitivo. Il punto non è solo fare meglio ciò che già esiste, ma immaginare modelli completamente nuovi di creazione del valore. Il vero salto avviene quando si riprogettano interi sistemi e scenari che trasformano il modo in cui si erogano servizi o si gestiscono le relazioni con i clienti. Questo richiede visione, non solo tecnologia.

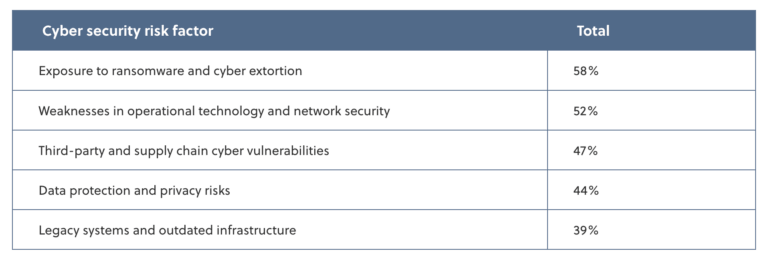

I temi della sicurezza, della privacy e della governance stanno emergendo con forza. Quanto incidono realmente questi fattori nel rallentare l’adozione?

Incidono tantissimo sia per gli incidenti in sé che già oggi possiamo immaginare, sia anche per l’incertezza strutturale. I modelli sono opachi, i dati distribuiti, le normative ancora in evoluzione: tutto questo rende difficile definire standard chiari di utilizzo. Di conseguenza, molte organizzazioni rallentano non solo per i rischi concreti, ma per l’assenza di riferimenti consolidati su cui costruire. A questo si aggiunge un problema più profondo: la mancanza di infrastrutture adeguate. Senza dati di qualità, processi ben definiti e sistemi di governance robusti, l’IA non scala. Funziona nei prototipi, ma fatica a entrare stabilmente in produzione.

Guardando al futuro e all’evoluzione verso modelli come l’agentic AI, quale dovrebbe essere la strategia delle organizzazioni per non restare indietro?

Il punto chiave è smettere di considerare l’IA come uno strumento e iniziare a vederla come un nuovo attore all’interno dell’organizzazione. Questo implica ripensare il rapporto uomo–tecnologia, ridisegnare i processi, ridefinire ruoli e responsabilità e investire seriamente nella formazione. Gli agenti, in particolare, introducono un cambio di paradigma: non si tratta più di supportare l’uomo, ma di delegare attività a sistemi che agiscono in autonomia. Questo amplifica le sfide di governance, fiducia e controllo, ma apre anche opportunità enormi. Le organizzazioni che avranno successo saranno quelle capaci di trasformarsi in sistemi ibridi uomo–agente, costruendo nel tempo competenze, infrastrutture e una visione strategica coerente. In altre parole, non vincerà chi adotta prima la tecnologia, ma chi saprà riprogettare sé stesso intorno ad essa.