L’Unione europea è indietro nella corsa globale al primato tecnologico e questo pone grandi rischi soprattutto nello sviluppo di tecnologie come l’intelligenza artificiale. Gli standard potrebbero essere creati altrove, da attori non democratici. Invece deve avvenire il contrario: l’Ue deve assumere il ruolo di chi definisce gli standard globali nell’Ai.

È quanto si legge nel testo della relazione con cui la commissione speciale del Parlamento europeo sull’intelligenza artificiale nell’era digitale (Aida) ha adottato le sue raccomandazioni finali sulle politiche per l’Ai in Europa dopo 18 mesi di indagini.

Indice degli argomenti

Non regole, ma politiche per sbloccare le opportunità

Il documento afferma che il dibattito pubblico sull’uso dell’intelligenza artificiale (Ai) dovrebbe concentrarsi sull’enorme potenziale di questa tecnologia come complemento di ciò che gli esseri umani possono fare.

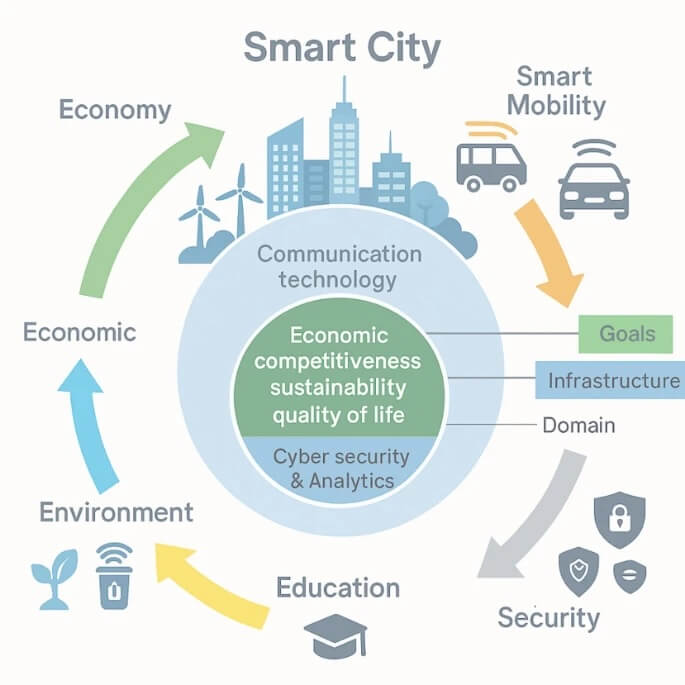

Gli eurodeputati offrono delle opzioni nelle politiche da adottare per sbloccare il potenziale dell’Ai in materia di salute, ambiente e cambiamenti climatici, per aiutare a combattere le pandemie e la fame nel mondo, nonché per migliorare la qualità della vita delle persone attraverso la medicina personalizzata. L’Ai, se combinata con il supporto di infrastrutture, istruzione e formazione ad hoc, può aumentare la produttività del lavoro, l’innovazione, la crescita sostenibile e la creazione di posti di lavoro.

L’Ue non dovrebbe in linea di massima regolamentare l’Ai di sé come tecnologia. Al contrario, il livello di intervento normativo dovrebbe essere proporzionato al tipo di rischio associato all’utilizzo di un sistema di Ai in un modo particolare.

La sfida del consenso globale sulle questioni etiche

Il documento della commissione Aida sottolinea anche che le tecnologie di intelligenza artificiale potrebbero porre questioni etiche e legali cruciali. Evidenzia la sfida di raggiungere un consenso all’interno della comunità globale sugli standard minimi per l’uso responsabile dell’Ai e le preoccupazioni per la ricerca militare e gli sviluppi tecnologici destinati a sistemi di offesa autonomi letali.

Le minacce alla privacy: occhio alle Big tech

Inoltre, alcune tecnologie di intelligenza artificiale consentono l’automazione dell’elaborazione delle informazioni su una scala senza precedenti. Ciò apre la strada alla sorveglianza di massa e ad altre interferenze illecite e rappresenta una minaccia per i diritti fondamentali, in particolare i diritti alla privacy e alla protezione dei dati.

I regimi autoritari applicano i sistemi di intelligenza artificiale per controllare, esercitare la sorveglianza di massa e classificare i propri cittadini o limitare la libertà di movimento. Le piattaforme tecnologiche dominanti le utilizzano per ottenere maggiori informazioni su una persona. Tale profilazione pone rischi per i sistemi democratici e per la salvaguardia dei diritti fondamentali, conclude il documento.

La relazione, adottata dalla commissione speciale Aida con 25 voti favorevoli, 2 contrari e 6 astensioni, verrà sottoposta al voto della Camera europea a maggio.